Das wichtigste auf einen Blick:

- 42% der Unternehmen in der deutschen Industrie nutzen bereits KI Tools in der Produktion (Bitkom, 2025) – fehlende Expertise zur Einbindung von KI in bestehende Prozesse gehört zu den häufigsten Hürden

- Computer Vision automatisiert zeitaufwändige Bild- und Punktwolkenanalyse und ersetzt fehleranfällige manuelle Prüfungen.

- Trainingsdatenqualität ist laut BSI (QUAIDAL-Leitfaden) der entscheidende Erfolgsfaktor – technisch wie regulatorisch.

- Data Drift und strikte Inferenzzeit-Anforderungen erfordern kontinuierliches Monitoring, nicht nur einmalige Implementierung.

- Der EU AI Act verfolgt einen risikobasierten Ansatz: Hochrisiko-KI-Systeme in der Fertigung brauchen nachweisliche Qualitätsmanagementsysteme.

- Datenschutz gilt bei kamerabasierter Bilderfassung im Betrieb – DSGVO-Konformität muss von Anfang an mitgedacht werden.

KI Qualitätssicherung verändert die Fertigung grundlegend – und das nicht erst seit gestern. Wer heute noch auf manuelle Sichtprüfung oder starre regelbasierte Systeme setzt, verliert im internationalen Wettbewerb an Boden. Denn Fehler, die das menschliche Auge übersieht, erkennen KI-gestützte Systeme in Millisekunden: zuverlässiger, schneller und rund um die Uhr.

Laut einer aktuellen Erhebung von Bitkom aus dem Jahr 2025 setzen bereits 42% der deutschen Industrieunternehmen künstliche Intelligenz in der Produktion ein – weitere 35% planen diesen Schritt. Gleichzeitig nennen 42% der Befragten fehlende Expertise zur Einbindung von KI in bestehende Prozesse als eine der größten Hürden. Genau hier setzt dieser Leitfaden an.

Doch „ein Modell trainieren" reicht nicht. Wie das Fraunhofer IGD beschreibt, scheitern automatisierte QS-Systeme häufig an Trainingsdatenaufwand, strikten Inferenzzeit-Anforderungen und variierenden Umgebungsbedingungen.

Wer KI in der Qualitätssicherung nachhaltig einsetzen will, braucht eine durchdachte End-to-End-Architektur – von der Kamera bis zum Compliance-Nachweis.

Warum Computer Vision jetzt der Hebel für KI Qualitätssicherung in der Fertigung ist

Von manueller Sichtprüfung zu KI/ML – was sich objektiv ändert

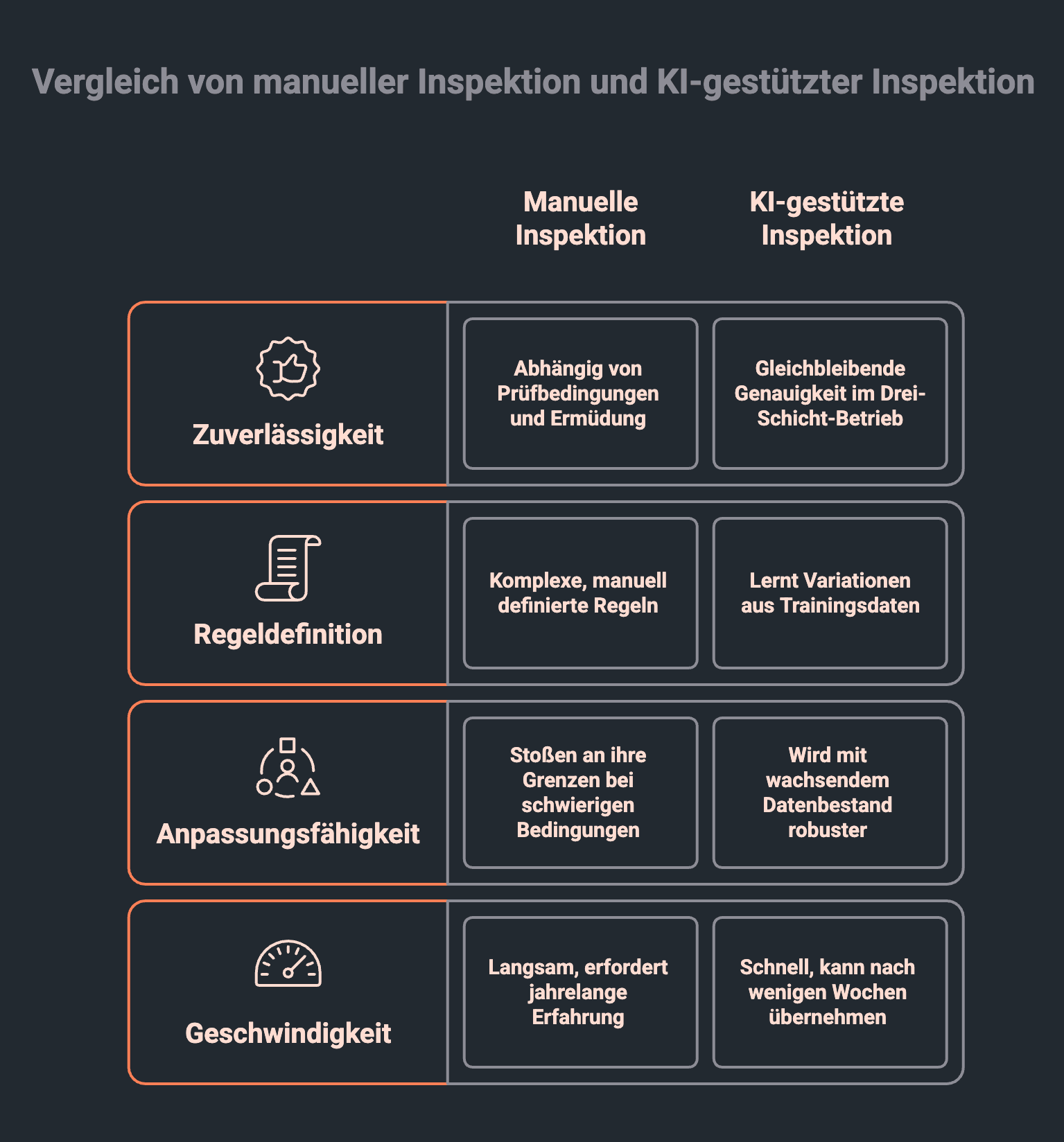

Die manuelle visuelle Inspektion ist die älteste Form der Qualitätskontrolle in der Fertigung. Jahrzehntelang haben erfahrene Mitarbeitende am Band Fehler mit bloßem Auge erkannt – ein Prozess, der zuverlässig funktioniert, solange die Prüfbedingungen konstant bleiben und Ermüdung keine Rolle spielt.

Das Fraunhofer IGD beschreibt es treffend: Klassische, regelbasierte Bildverarbeitungssysteme benötigen komplex, manuell definierte Regeln sowie tiefes Expertenwissen – und stoßen an ihre Grenzen, sobald Lichtverhältnisse, Materialeigenschaften oder Produktvarianten schwer zu kontrollieren sind. KI-Systeme auf Basis von Machine Learning und Deep Learning hingegen lernen diese Variationen aus Trainingsdaten und werden mit wachsendem Datenbestand robuster.

Das Resultat: Dieselbe Prüfaufgabe, die früher ein geschulter Mitarbeitender nach Jahren der Erfahrung beherrschte, kann ein gut trainiertes KI-Modell nach wenigen Wochen übernehmen – und das mit gleichbleibender Genauigkeit im Drei-Schicht-Betrieb.

Welche Aufgaben Computer Vision in der Qualitätssicherung typisch abdeckt

KI-gestützte visuelle Inspektion deckt in der Produktion vor allem drei Kernaufgaben ab:

- Fehlererkennung: Kratzer, Risse, Verschmutzungen oder Geometrieabweichungen auf Oberflächen

- Fehlerklassifikation: Differenzierung zwischen kritischen und unkritischen Defekttypen

- Vollständigkeitsprüfung: Kontrolle, ob alle Bauteile korrekt verbaut oder vorhanden sind

Ergänzend dazu beschreibt das Fraunhofer IOSB-INA Computer Vision als Automatisierung zeitaufwändiger Bild- und Punktwolkenanalyse – sowohl für 2D-Farbkameras als auch für 3D-Sensoren (LiDAR, Thermalkameras), die Geometrie und Temperaturverteilung erfassen.

Praxisindikator: Relevanz im deutschen Markt

Die Zahlen sprechen eine klare Sprache: 82 % der deutschen Industrieunternehmen sehen KI als entscheidend für ihre künftige Wettbewerbsfähigkeit – so die aktuelle Bitkom-Erhebung. Die größten Hürden? Fehlende Expertise (42 %), Zeitmangel und rechtliche Unsicherheiten. Genau diese Kombination macht professionelle Begleitung bei der Implementierung unverzichtbar.

Systemdesign: Von Kamera und Sensorik bis Edge, Datenintegration und QS-Dashboards

Datenquellen & Sensorik: Was wirklich zählt

Die Basis jedes KI-Systems in der Qualitätssicherung sind hochwertige Sensordaten. Das Fraunhofer IPA nennt optische Sensordaten – also Bilder und 3D-Messdaten – als häufigste Datenbasis für lernende Verfahren in der Produktionsprüfung. Hinzu kommen Sensor- und Maschinensteuerungsdaten, aus denen KI-gestützte Systeme sogar Qualitätsprognosen ableiten und Prozesse nachregeln können.

Je nach Anwendungsfall kommen unterschiedliche Sensortypen zum Einsatz:

Trainingsdaten, Labeling und das Problem seltener Defekte

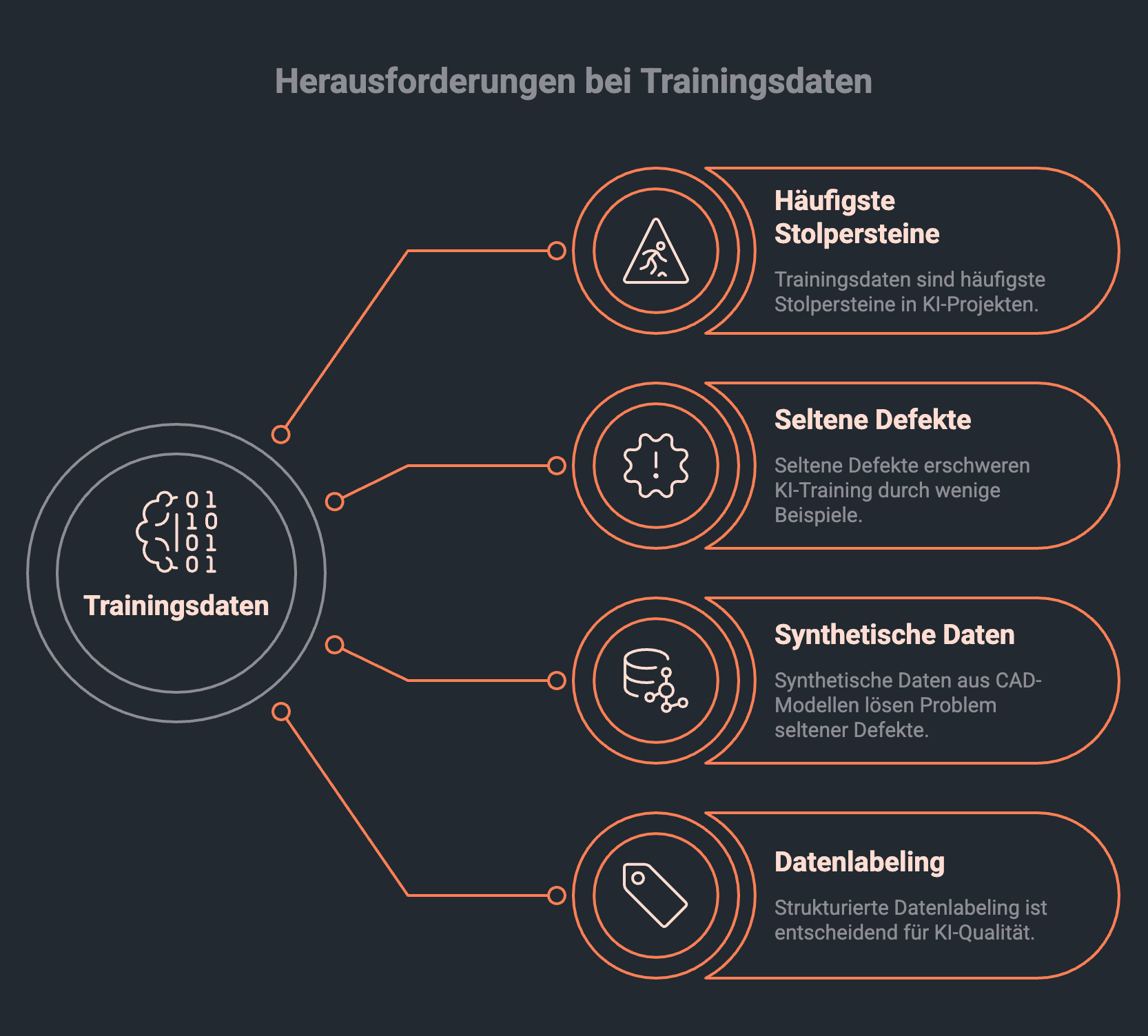

Der häufigste Stolperstein in KI-Projekten zur Qualitätssicherung ist nicht das Modell selbst – es sind die Trainingsdaten. ML-Modelle werden durch die Aufnahme, das Labeling und die Auswertung von Bilddaten trainiert, um Fehler anschließend selbstständig zu erkennen.

Das klingt einfach, hat aber eine kritische Schwachstelle: Seltene Defekte.

Wenn ein bestimmter Fehlertyp nur ein- bis zweimal pro tausend Teile auftritt, gibt es schlicht zu wenige Trainingsbeispiele. Ein eleganter Lösungsweg: synthetische Trainingsdaten aus CAD-Modellen – verfügbar noch bevor das erste physische Bauteil existiert.

Praxis-Tipp: Planen Sie von Anfang an ein strukturiertes Datenlabeling ein. Schlechte Labelqualität potenziert sich im Training und führt zu unreliablen KI-Systemen – unabhängig davon, wie leistungsfähig das gewählte Modell ist.

Inline-Betrieb & Performance: Wenn jede Millisekunde zählt

KI-gestützte Qualitätssicherung in der Fertigungslinie bedeutet Echtzeit-Entscheidungen. Das Fraunhofer IGD identifiziert strikte Inferenzzeit-Anforderungen als eine der zentralen Herausforderungen beim Inline-Einsatz: Das Modell muss ein Ergebnis liefern, bevor das Teil die Prüfstation verlassen hat.

Hier kommt Edge AI ins Spiel: Statt Bilddaten in eine Cloud zu übertragen, läuft die Inferenz direkt auf leistungsstarker Hardware an der Maschine. Das reduziert Latenz drastisch, schont Netzwerkbandbreite und hält sensible Produktionsdaten im eigenen Netzwerk.

Monitoring, Data Drift und kontinuierliche Verbesserung

Ein KI-Modell, das heute hervorragend funktioniert, kann in sechs Monaten deutlich schlechter performen – ohne dass jemand es bemerkt. Der Grund: Data Drift. Dieses Phänomen entsteht durch wechselnde Umgebungsfaktoren: veränderte Beleuchtung, neue Lieferantenmaterialien, Produktvarianten, Maschinenverschleiß.

KI-Qualitätssicherung sollte daher konsequent als durchgängiger Lebenszyklus verstanden werden: von der Datenerfassung über die Modellentwicklung und das Deployment bis hin zum produktiven Monitoring und der kontinuierlichen Verbesserung.

Integration in Geschäftsprozesse: Vom QS-Event zur Management-Entscheidung

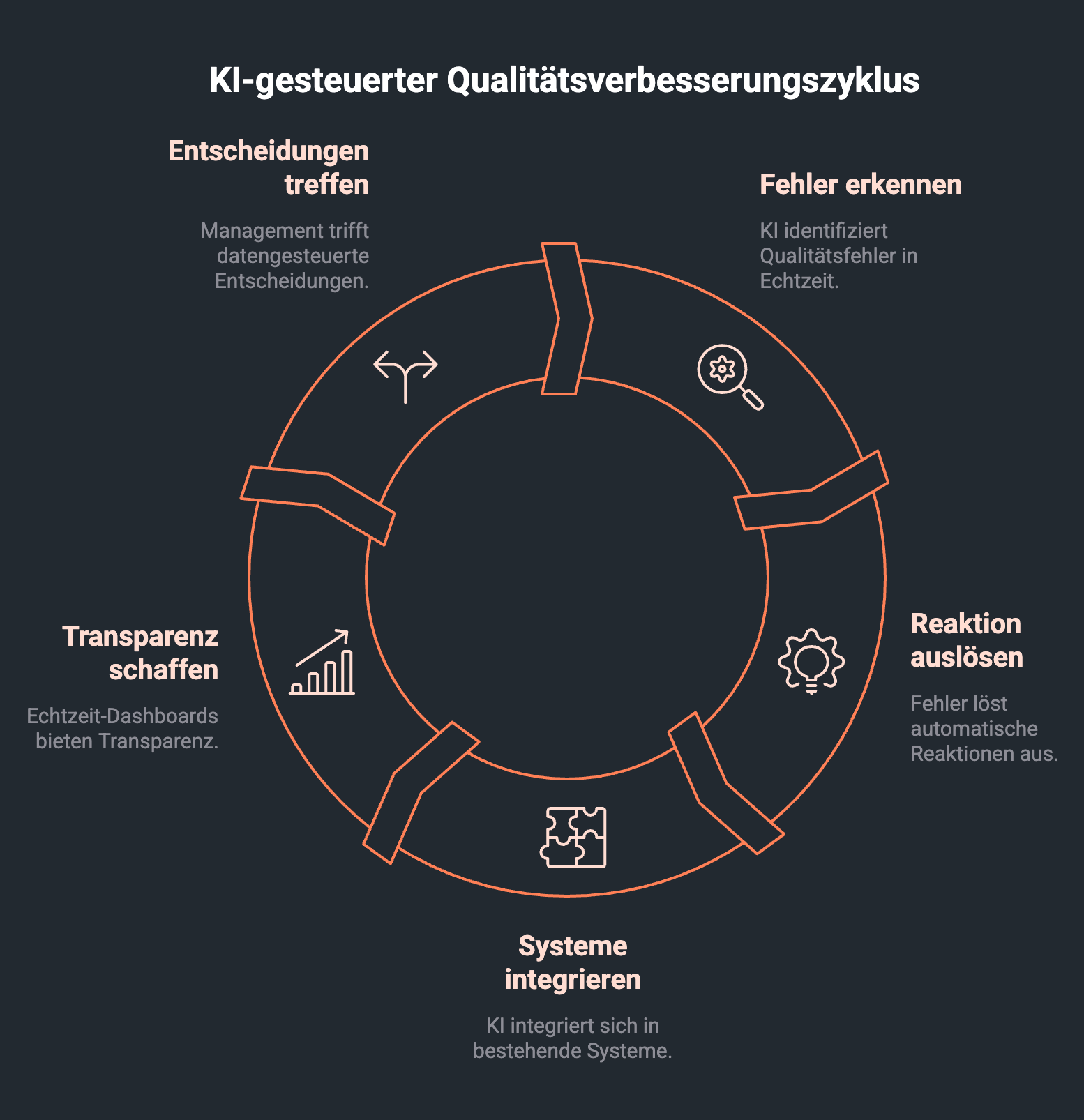

Die eigentliche Wertschöpfung entsteht nicht im Modell, sondern in der Prozesskette dahinter. Ein erkannter Fehler muss automatisch eine Reaktion auslösen: Werkstück ausschleusen, Alarm an die Schichtleitung, Eskalation bei Häufung, Eintrag ins Qualitätsmanagementsystem.

Das erfordert eine saubere Integration in bestehende Systeme (MES, ERP) sowie durchdachte Workflows und Dashboards. Bei Hanisch Consulting setzen wir genau hier an: KI-Agents, die Qualitätsereignisse auswerten und weiterleiten, Echtzeit-Dashboards mit den relevanten KPIs für Produktion und Qualitätsmanagement sowie automatisierte Workflows, die manuelle Koordination ersetzen.

Das Ergebnis: Transparenz über den gesamten Qualitätsprozess – in Echtzeit, nachvollziehbar und auditfähig.

Messgrößen, Nachweise und was „Qualität" wirklich bedeutet

Was KI-Qualitätssicherung im Enterprise-Sinn umfasst

KI-Qualitätssicherung ist ein systematischen Ansatz, mit dem Unternehmen über den gesamten KI-Lifecycle hinweg Standards für Genauigkeit, Verlässlichkeit, Robustheit, Fairness und Business-Relevanz sicherstellen. Das ist weit mehr als „Fehler finden": Es geht um nachweisbare, reproduzierbare und auditierbare Prozesse.

Relevante Metriken für die operative Steuerung sind unter anderem:

- Erkennungsrate (Recall): Welcher Anteil echter Fehler wird erkannt?

- Präzision: Wie viele als fehlerhaft klassifizierte Teile sind tatsächlich fehlerhaft?

- False-Positive-Rate: Wie oft werden gute Teile fälschlicherweise ausgeschleust?

- Inferenzzeit: Verarbeitung innerhalb des Inline-Zeitfensters?

- Drift-Indikator: Veränderung der Modell-Performance über Zeit

Datenqualität als Fundament – der QUAIDAL-Leitfaden des BSI

Das Bundesamt für Sicherheit in der Informationstechnik (BSI) stellt unmissverständlich klar: Trainingsdatenqualität ist der entscheidende Erfolgsfaktor für KI-Projekte – sowohl technisch als auch regulatorisch. Mit dem QUAIDAL-Katalog stellt das BSI einen methodischen Leitfaden bereit, der konkrete Qualitätskriterien für KI-Trainingsdaten definiert.

Ergänzend formuliert der Bitkom-Leitfaden KI & Informationssicherheit den Zusammenhang prägnant: Datenqualität gleich KI-Qualität. Wer bei der Datenbasis spart, spart am falschen Ende.

Sicherheitsanforderungen bei Cloud-basierten KI-Diensten

Nutzen Sie externe KI-Dienste oder Cloud-Infrastruktur für Ihre Qualitätssicherung, sollten Sie den AIC4-Kriterienkatalog des BSI kennen. Er beschreibt Mindestanforderungen für den sicheren Einsatz von ML-Methoden in Cloud-Services und hilft, Anbieter nach objektiven Sicherheitskriterien zu bewerten.

Einsatz von KI: Recht & Compliance im DACH-Kontext

EU AI Act: Risikobasiert, verbindlich, jetzt relevant

Der EU AI Act ist keine zukünftige Regulierung mehr – er ist in Kraft. Für Hochrisiko-KI-Systeme greifen zentrale Pflichten stufenweise, insbesondere ab August 2026 für viele Hochrisiko-Anwendungen nach Anhang III und ab August 2027 für bestimmte Produkt- und Sicherheitskomponenten nach Anhang I, wobei aktuell über mögliche Verlängerungen einzelner Fristen diskutiert wird.

Die Bundesregierung beschreibt ihn als risikobasiertes Regelwerk: Je höher das Risiko, desto strenger die Anforderungen. Für Fertigungsunternehmen bedeutet das konkret: KI-Systeme, die in sicherheitsrelevante Prozesse eingebunden sind, können als Hochrisiko-KI eingestuft werden.

Für solche Systeme schreibt Artikel 17 des AI Act Act die Einführung eines Quality Management Systems (QMS) für die jeweiligen Anbieter vor – also strukturierte Dokumentation, Nachweispflichten, Risikobewertungen und Monitoring-Prozesse. Wer das ignoriert, riskiert nicht nur Bußgelder, sondern auch den Betrieb seiner Produktionslinie.

Wichtiger Hinweis: Die rechtliche Einordnung Ihrer spezifischen KI-Systeme unter den EU AI Act sollte rechtlich geprüft werden. Dieser Artikel dient der allgemeinen Information, nicht der Rechtsberatung.

Datenschutz bei Kameras und Bilddaten in der Produktion

Ein oft unterschätzter Aspekt: Kamerabasierte Qualitätssicherung in der Fertigung ist Datenverarbeitung im Sinne der DSGVO – sobald Mitarbeitende im Bild erfasst werden könnten. Der Bundesbeauftragte für den Datenschutz (BfDI) stellt klar: Berufliche und wirtschaftliche Nutzung fällt nicht unter die private Ausnahme und verweist auf die EDPB-Leitlinien zur Videoverarbeitung.

Für den deutschen Markt ist zudem die DSK-Orientierungshilfe zur Videoüberwachung relevant, die konkrete Anforderungen für nicht-öffentliche Stellen formuliert. Empfehlung: Datenschutz-Folgenabschätzung (DPIA) frühzeitig einplanen und rechtlich absichern.

Praxisbeispiele: Was die Forschung belegt

Die Leistungsfähigkeit KI-gestützter Qualitätssicherung ist kein Marketingversprechen – sie ist dokumentiert. Das Fraunhofer IPA veröffentlicht konkrete Kennzahlen aus realen Industrieprojekten:

- Laserschnittkanten-Prüfung: Korrelationsraten von 75 % (Rauheitsbewertung) und 85 % (Gratbewertung) mit lernenden Systemen

- Selbstlernende Oberflächenprüfung: Robuster 100-Prozent-Prüfbetrieb direkt im Prozess – ohne manuellen Eingriff

- Bildanalyse Zebrafischeier: Erkennungsrate von 99,8 % trotz beliebiger Orientierung der Objekte

Das Fraunhofer ITWM SimVision entwickelt darüber hinaus KI-Inspektionssysteme, die gezielt auf das Problem seltener Defekte ausgerichtet sind und durch Simulation synthetischer Daten die Transparenz und Zuverlässigkeit verbessern.

Einen praxisnahen Demonstrator bietet das GFE-Netzwerk: Dort lässt sich visuelle QS nach der Montage live erleben – inklusive der Möglichkeit, eigene Bilder aufzunehmen, zu labeln und ein Modell nachzutrainieren.

Internationale Trends: Was DACH-Unternehmen wissen müssen

Die Entwicklung KI-gestützter Qualitätssicherung ist kein nationales Phänomen – sie wird durch internationale Normen und Frameworks geformt, die auch für DACH-Unternehmen verbindlich werden.

- ISO/IEC 42001 gilt als weltweit erster Standard für KI-Managementsysteme. Er adressiert u. a. Governance, Transparenz und kontinuierliche Verbesserung von KI-Systemen und ergänzt Leitfäden wie ISO/IEC 23894 zur KI-spezifischen Risikosteuerung. ISO/IEC 23894 ergänzt dies um konkrete Guidance zur KI-spezifischen Risikosteuerung und zur Integration von Risikomanagement in KI-Aktivitäten – ein direkter Anknüpfungspunkt an den EU AI Act.

- ISO/IEC 23894 ergänzt dies um konkrete Guidance zur KI-spezifischen Risikosteuerung und zur Integration von Risikomanagement in KI-Aktivitäten – ein direkter Anknüpfungspunkt an den EU AI Act.

- Das NIST AI Risk Management Framework aus den USA ist für DACH-Unternehmen relevant, wenn sie global liefern, Audits vorbereiten oder US-Partneranforderungen erfüllen müssen. Der Rahmen bietet strukturierte Methoden zur Risikobewertung und -steuerung. Details gibt es beim NIST.

- Im deutschen Kontext liefert die Deutsche Normungsroadmap Künstliche Intelligenz (Ausgabe 2) des DIN eine aktualisierte Analyse des Standardisierungsbedarfs – unverzichtbar für Unternehmen, die ihre KI-Systeme langfristig normenkonform aufstellen wollen.

Der Trend ist eindeutig: KI-Governance wird zur Pflicht, nicht zur Kür. Wer jetzt die Grundlagen legt – Datenqualität, Dokumentation, Monitoring –, spart erheblichen Aufwand, wenn neue Normen und Gesetze verbindlich werden.

Fazit: KI Qualitätssicherung braucht mehr als ein trainiertes Modell

Computer Vision und Deep Learning sind leistungsstarke Werkzeuge – aber kein Selbstläufer. Die Quellen sind eindeutig: Robuste KI-gestützte Qualitätssicherung in der Fertigung scheitert häufig nicht an der Technologie, sondern an fehlenden Engineering-Prozessen, unzureichender Datenqualität und fehlendem Monitoring.

Gleichzeitig zeigen die DACH-Marktdaten, dass die Adoption wächst – und der regulatorische Druck durch den EU AI Act zunimmt. Unternehmen, die jetzt in eine saubere End-to-End-Architektur investieren – von der Sensorik über die Datenpipeline bis zum QS-Dashboard und zur Compliance-Dokumentation – sind klar im Vorteil.

Bereit für den nächsten Schritt?

Hanisch Consulting begleitet Sie bei der Implementierung von KI-Qualitätssicherung: von der Potenzialanalyse über die Systemarchitektur bis zur Integration in Ihre bestehenden Workflows und Dashboards.

Über Hanisch Consulting

Hanisch Consulting GmbH begleitet Unternehmen – insbesondere KMU – bei der digitalen Transformation durch maßgeschneiderte KI-Strategien, automatisierte Workflows und datengetriebene Entscheidungsprozesse. Leistungsschwerpunkte: KI-Agents, Datenanalyse & -integration, BI/Dashboards, Geschäftsprozessoptimierung sowie GenAI- und RAG-Workflows.

Jetzt Erstberatung vereinbaren – kostenlos & unverbindlich

Die meisten Geschäftsführer kennen weder die Kosten noch die Ergebnisse ihrer KI-Projekte.

.avif)